Warum Datengovernance-Richtlinien für die Reduzierung von Cloud-Speicherkosten entscheidend sind

Daten gelten oft als das neue Gold – umso wichtiger ist ein verantwortungsvoller Umgang mit ihnen. Das ist nicht nur eine Frage der Sicherheit oder Compliance, sondern zunehmend auch eine Frage der Kosten. Datengovernance-Richtlinien helfen direkt dabei, Cloud-Speicherkosten zu senken. Ohne klare Vorgaben wird die anfangs praktische Flexibilität der Cloud schnell zum unkontrollierten Wildwuchs. Das kann Sicherheitsprobleme verursachen und gleichzeitig das Budget belasten. Die Cloud wirkt durch Skalierung und „Pay as you go“ zunächst günstig – ohne klare Steuerung können die monatlichen Rechnungen jedoch schnell steigen. Unternehmen ohne aktive Datenstrategie geraten leicht in einen Kreislauf aus redundanten Daten, ungenutzten Ressourcen und langsamen Prozessen. Darum ist ein verantwortungsvoller Umgang mit wachsenden Datenmengen kein optionales Zusatzthema, sondern ein zentraler Bestandteil jeder modernen IT-Strategie. Nur so lassen sich moderne Lösungen wie ein cloud speicher effizient nutzen, ohne die Ausgaben aus dem Blick zu verlieren.

Diese Richtlinien legen fest, wer auf welche Daten zugreifen darf, wie Daten im Unternehmen verwaltet werden und wie Sicherheit und Qualität dauerhaft gewährleistet bleiben. Gute Datengovernance hilft, regulatorische Vorgaben einzuhalten, Abläufe zu verbessern und vor allem unnötige Cloud-Speicherkosten deutlich zu senken. Es geht darum, Übersicht zu schaffen und Prozesse zu automatisieren, damit nur die Daten gespeichert werden, die tatsächlich benötigt werden – in der passenden Menge, am richtigen Ort und nur so lange wie nötig.

Was sind Datengovernance-Richtlinien im Kontext von Cloud-Speicherung?

Datengovernance wird in der digitalen Arbeitswelt immer wichtiger, besonders beim Cloud-Speicher. Mit Hybrid-Arbeit und Homeoffice braucht es klare Regeln, damit Daten nicht unkontrolliert verstreut liegen. Was steckt dahinter, und warum spielen Richtlinien in Cloud-Umgebungen eine so große Rolle?

Definition und Ziele von Datengovernance

Es gibt keine einzige, universell gültige Definition. Vereinfacht gesagt bedeutet Datengovernance: verbindliche Regeln für den Umgang mit bestimmten Daten. Im Kern geht es darum, Methoden, Zuständigkeiten und Abläufe festzulegen, die regeln, wie Daten im Unternehmen standardisiert, zusammengeführt, geschützt und gespeichert werden. Dabei stehen Datenqualität, Datensicherheit und korrekte Verarbeitung im Fokus. Es geht also um Regeln und zugleich um passende Werkzeuge, die das Datenmanagement erleichtern und sicheren Zugriff ermöglichen.

Ein zentrales Ziel ist Überblick und Kontrolle über alle Datenbestände. Dazu gehören klare Zugriffsrechte, damit Mitarbeitende nur auf das zugreifen, was sie für ihre Arbeit benötigen (Need-to-know). Das spart Aufwand und Kosten in der Verwaltung und Speicherung, erleichtert zugleich die Einhaltung gesetzlicher Anforderungen und reduziert Rechtsrisiken. Außerdem unterstützt Datengovernance die Einhaltung von Compliance-Vorgaben, zum Beispiel im Datenschutz.

Rolle von Richtlinien in Cloud-Infrastrukturen

In Cloud-Infrastrukturen sind Datengovernance-Richtlinien von besonderer Bedeutung. Die Cloud ermöglicht eine schnelle Reaktion auf neue Anforderungen. Gleichzeitig sind Multi-Cloud-, Hybrid-Modelle und KI-gestützte Cloud-Dienste schwerer zu überblicken. Ohne Governance steigt das Risiko, die Kontrolle zu verlieren. Typische Folgen sind überhöhte Kosten, schlechte Auslastung von Cloud-Ressourcen, Sicherheitsvorfälle, Datenlecks und Verstöße gegen regulatorische Vorgaben.

Cloud-Governance umfasst Praktiken, mit denen Unternehmen die Cloud sinnvoll nutzen und Risiken begrenzen. Dazu gehören Sicherheit, Kosten und Betrieb, aber auch neuere Themen wie KI-Governance, Nachhaltigkeit (GreenOps) und die automatisierte Durchsetzung von Regeln (Policy as Code). Ein Cloud-Governance-Framework beschreibt, wie wichtige Aspekte des Cloud-Betriebs gesteuert und sensible Daten geschützt werden. Es hilft auch dabei, KI-Modelle, automatisierte Abläufe und Datenpipelines nachvollziehbar und regelkonform zu betreiben. So können Nutzer effizient in der Cloud arbeiten, während der Betrieb effizienter und günstiger wird und IT-Teams Deployments überwachen und bei Bedarf korrigieren können.

Wie beeinflussen Datengovernance-Richtlinien die Cloud-Speicherkosten?

Der Zusammenhang zwischen Datengovernance und Cloud-Speicherkosten ist direkter, als viele zunächst annehmen. Was nach reiner „Verwaltung“ klingt, ist in der Praxis ein wirksames Instrument zur Kostensenkung und Ausgabenkontrolle.

Mechanismen zur Kostenkontrolle durch Richtlinien

Richtlinien setzen klare Regeln, die direkt auf die Speicherkosten einwirken. Ein besonders wirkungsvoller Hebel ist das Need-to-know-Prinzip. Wenn klar definiert ist, wer welche Daten benötigt, sinkt die Wahrscheinlichkeit, dass Daten unnötig kopiert oder in teuren Speicherstufen vorgehalten werden. Das führt zu weniger Datenballast und weniger kaum genutzten Ressourcen.

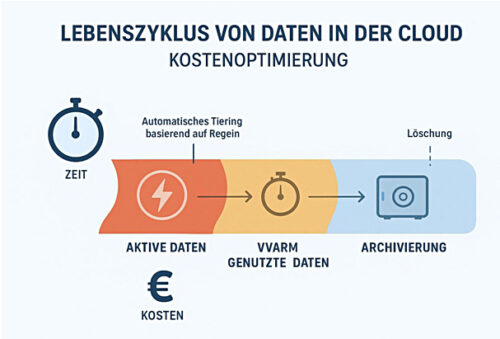

Darüber hinaus helfen Richtlinien dabei, Prozesse für Datenlebenszyklen zu automatisieren. Daten müssen nicht dauerhaft im teuersten Speicher verbleiben. Stattdessen lässt sich festlegen, dass Daten nach einer definierten Zeit automatisch in günstigere Speicherklassen verschoben werden (Tiering) oder gelöscht werden, sobald sie nicht mehr benötigt werden. Viele Cloud-Anbieter stellen hierfür entsprechende Funktionen bereit. Das reduziert den manuellen Aufwand, vermeidet Fehler und stellt sicher, dass Speicherressourcen kontinuierlich bedarfsgerecht zugeteilt werden – was die Betriebskosten nachhaltig senkt. Wie anspruchsvoll die Umsetzung solcher Compliance- und Datenschutzvorgaben in der Praxis für Unternehmen ist, zeigt sich besonders deutlich, wenn technische und organisatorische Maßnahmen zusammenwirken müssen.

Typische Kostentreiber im Cloud-Speicher

Cloud-Speicher kann schnell teuer werden, wenn Daten nicht aktiv verwaltet werden. Ein häufiger Kostentreiber ist unkontrolliertes Datenwachstum. Mit der Zeit sammeln sich erhebliche Mengen an: redundante Daten, veraltete Bestände oder Daten, die niemand mehr nutzt. Jedes unnötige Gigabyte verursacht Kosten – nicht nur für die Speicherung selbst, sondern auch für Verwaltung, Backup und Absicherung.

Ein weiterer Kostentreiber sind falsch gewählte Speicherklassen. Anbieter wie Amazon S3, Google Cloud Storage oder Azure Blob Storage bieten mehrere Klassen an (Standard, Infrequent Access, Cold Storage). Die Standard-Klasse ist für häufigen Zugriff ausgelegt und in der Regel am teuersten. Wenn selten genutzte Archivdaten dort verbleiben, entstehen unnötige Mehrkosten. Hinzu kommen Abruf- oder Transfergebühren, insbesondere bei günstigeren Archivklassen, wenn Daten häufiger abgerufen werden als geplant. Ohne klare Datenklassifizierung und ein Konzept für die Verschiebung zwischen den Speicherklassen können erwartete Einsparungen schnell zunichte gemacht werden.

Auswirkungen klarer Datenlebenszyklusregeln auf die Ausgaben

Klare Regeln für den Datenlebenszyklus bilden die Grundlage zur nachhaltigen Reduzierung der Cloud-Speicherkosten. Sie legen fest, wie lange Daten in welcher Klasse verbleiben und wann sie archiviert oder gelöscht werden. Ein Beispiel: Projektdaten bleiben 6 Monate im Standard-Speicher, wandern dann 2 Jahre in Infrequent Access, danach 5 Jahre in Cold Storage und werden anschließend gelöscht, sofern keine gesetzlichen Aufbewahrungspflichten bestehen.

Solche Regeln – idealerweise automatisiert – wirken direkt auf die Kosten. Sie verhindern, dass Daten zu lange in teuren Klassen verbleiben. Wenn Daten automatisch in günstigere Optionen verschoben oder gelöscht werden, schrumpft der Speicherbedarf deutlich. So lassen sich Kosten dauerhaft senken, ohne auf Leistung, Skalierung oder Sicherheit verzichten zu müssen. Gleichzeitig entsteht die nötige Übersicht, um fundierte Entscheidungen zur Ablage jeder Datenkategorie zu treffen.

Welche Risiken entstehen ohne effektive Datengovernance in der Cloud?

Wenn Datengovernance in der Cloud fehlt, kann das weitreichende Folgen haben – oft mit erheblichen finanziellen Konsequenzen. Die anfängliche Freude über schnelle Skalierung und flexible Nutzung weicht schnell, sobald das Unternehmen den Überblick über Daten und Kosten verliert.

Datenwachstum und Schatten-IT als Kostenfalle

Ohne Governance wächst die Datenmenge schnell unkontrolliert. Fachabteilungen nutzen eigene Tools und Plattformen, um schnell arbeiten zu können – so entsteht Schatten-IT. Die zentrale IT hat dann kaum noch Überblick und Kontrolle. Jede zusätzliche Insellösung erhöht Risiko, Aufwand und Komplexität. Sensible Daten können in Cloud-Speichern landen, die nicht ausreichend abgesichert sind und weder interne Anforderungen noch externe Vorgaben erfüllen.

Das wird auch zur Kostenfalle: Speicher wird mehrfach gebucht, Dienste werden fehlerhaft konfiguriert, und ein übergreifendes Ressourcenmanagement fehlt. Die Kosten steigen, weil jede Abteilung eigene Speicherpakete nutzt, ohne dass die Gesamtausgaben geprüft oder optimiert werden. Hinzu kommt eine fragmentierte Datenlandschaft, die Abläufe verlangsamt und Entscheidungen erschwert.

Redundante und ungenutzte Speicherressourcen

Ohne klare Regeln für Ablage, Aufbewahrung und Löschung sammeln sich redundante und ungenutzte Daten an. Dateien werden mehrfach gespeichert, Backups werden unnötigerweise mehrfach angelegt, alte Datenbestände verbleiben im System, obwohl sie keinen Mehrwert mehr bieten. Redundante Daten bedeuten letztlich redundante Kosten. Methoden wie Deduplizierung und Komprimierung, die bei guter Governance zum Standard gehören würden, kommen dann oft gar nicht zum Einsatz.

So zahlen Unternehmen für Speicherplatz, den sie nicht benötigen. Typische Beispiele sind Testdaten nach Projektabschluss oder veraltete Dokumentversionen, die niemand mehr verwendet. Ohne regelmäßige Bereinigung und Lifecycle-Management verbleiben diese Daten in teuren Klassen und verursachen laufend Kosten, die sich leicht vermeiden ließen.

Mögliche Compliance-Verstöße und deren finanzielle Folgen

Das größte Risiko bilden oft Compliance-Verstöße und deren finanzielle Konsequenzen. Gesetze und Regelwerke wie DSGVO, CCPA oder neuere Vorgaben wie NIS2, DORA oder der EU AI Act verlangen Transparenz, Zugriffskontrolle und lückenlose Nachweise – unabhängig davon, wo Daten gespeichert sind. Ohne zentrale Cloud-Datengovernance wird es sehr schwierig, Herkunft, Zugriffe und Schutzmaßnahmen sauber nachzuweisen. Die Folgen können empfindliche Strafen sein, teils in Millionenhöhe. Neben Bußgeldern drohen Imageverlust, Vertrauensbruch bei Kunden und Betriebsstörungen. Diese indirekten Kosten können gravierender sein als die Strafe selbst. Stringente Governance senkt dieses Risiko erheblich und hilft dabei, bei Prüfungen nachzuweisen, dass Cloud-Risiken verantwortungsvoll gesteuert werden.

Welche Prinzipien und Best Practices senken Cloud-Speicherkosten?

Wer Cloud-Speicherkosten senken will und dabei die Vorteile der Cloud erhalten möchte, braucht klare Prinzipien und bewährte Methoden – technisch wie organisatorisch, über den gesamten Datenlebenszyklus hinweg.

Vermeidung von Daten-Redundanz

Ein Grundprinzip lautet: redundante Daten vermeiden. Wer Daten doppelt speichert, zahlt auch doppelt. In vielen Unternehmen entstehen unbemerkt Kopien – durch ungeplante Backups, fehlende Deduplizierung oder zu viele Dateiversionen.

Bewährte Maßnahmen:

- Deduplizierung einsetzen, damit gleiche Datenblöcke nur einmal gespeichert werden

- Daten vor dem Upload komprimieren, um Speicherplatz zu sparen

- Eine klare Backup-Strategie definieren (was, wie oft, wo), damit keine unnötigen Kopien entstehen

Viele Cloud-Anbieter stellen hierfür integrierte Funktionen bereit.

Automatisierung von Speicher-Bereinigungsvorgängen

Manuelles Aufräumen ist langsam, fehleranfällig und für dynamische Cloud-Umgebungen ungeeignet. Automatisierung ist daher ein Schlüssel zur nachhaltigen Kostenkontrolle. Mit automatischen Lifecycle-Regeln werden Daten, die nicht mehr aktiv genutzt werden, in günstigere Klassen verschoben oder gelöscht.

Konkrete Beispiele sind AWS S3 Lifecycle Management oder Azure Blob Storage Lifecycle Management. Diese Automatisierung stellt sicher, dass Daten stets in der kosteneffizientesten passenden Speicherklasse abgelegt sind. Sie reduziert den Verwaltungsaufwand und minimiert Fehler durch manuelle Eingriffe.

Datenklassifizierung und Zugriffsmanagement

Nicht jede Datei hat den gleichen Wert oder die gleiche Zugriffshäufigkeit. Darum ist Datenklassifizierung als Fundament für sinnvolles Datenmanagement und geringere Kosten unerlässlich. Sensible Daten benötigen stärkeren Schutz und mitunter teurere Speicheroptionen. Öffentliche oder weniger kritische Daten können kostengünstiger abgelegt werden.

Wenn Daten nach Sensibilität, Geschäftswert und Zugriffshäufigkeit kategorisiert sind, lässt sich die passende Speicherklasse gezielt auswählen. Gleichzeitig hält ein striktes Zugriffsmanagement nach dem Need-to-know-Prinzip die Datenlandschaft kompakt und überschaubar. Richtlinien helfen Datenverantwortlichen, Produktteams und Entwicklern, zu verstehen, wie Daten je nach Klasse geschützt werden und wer Zugriff benötigt. So entstehen weniger redundante Kopien und weniger kostspielige Fehlablagen.

Implementierung von Lösch- und Archivierungsrichtlinien

Eng verbunden mit Automatisierung und Klassifizierung sind klare Regeln für das Löschen und Archivieren. Diese Regeln legen fest, wie lange Daten gespeichert werden und wann sie in günstigere Archivsysteme überführt oder dauerhaft gelöscht werden. Das ist sowohl für Compliance als auch für die Kostensteuerung entscheidend.

Beispiel: Daten, die nicht mehr aktiv benötigt werden, aber aus rechtlichen Gründen aufbewahrt werden müssen, werden in Cold Storage verschoben (z. B. Amazon S3 Glacier oder Google Cloud Storage Coldline). Der Datenzugriff dauert länger, kostet jedoch deutlich weniger. Nach Ablauf der Aufbewahrungsfrist sollten Daten sicher und unwiderruflich gelöscht werden, um keine weiteren Kosten zu verursachen.

Wie implementiert man wirksame Datengovernance-Richtlinien in der Cloud?

Wirksame Datengovernance in der Cloud ist kein einmaliges Projekt, sondern kontinuierliche Arbeit. Sie erfordert Planung, klare Zuständigkeiten und den Einsatz geeigneter Technologien. Das Ziel ist eine Struktur, die zur Cloud passt und gleichzeitig Kontrolle und Effizienz gewährleistet.

Schritte zur Erstellung und Einführung von Richtlinien

Ein Cloud-Governance-Framework lässt sich in wenige zentrale Schritte gliedern:

Cloud-Risiken bewerten Ressourcen und Konfigurationen prüfen, um Schwachstellen zu identifizieren (z. B. Datenschutzlücken, unnötige Ressourcen, mangelnde Datenqualität).

Risikotoleranz festlegen Entscheiden, welche Risiken akzeptiert werden und welche über Richtlinien gesteuert werden müssen.

Richtlinien formulieren Richtlinien beschreiben die Ziele (z. B. Kostenreduktion, Sicherheit, Effizienz). Verfahren beschreiben, wie diese Ziele erreicht werden. Beides sollte getrennt dokumentiert sein.

Bestehende Regeln aus dem On-Premises-Betrieb können manchmal übernommen werden – häufig sind jedoch neue Vorgaben erforderlich, auch im Hinblick auf Anforderungen wie NIS2, DORA oder den EU AI Act.

Rollen und Verantwortlichkeiten im Governance-Prozess

Datengovernance gelingt nur, wenn mehrere Ebenen aktiv mitwirken: IT, Unternehmensführung, Fachbereiche und auch Endnutzer. Rollen und Zuständigkeiten müssen klar definiert sein.

Typische Rollen:

- Data Governance Officer oder Data Governance Committee: definiert, überwacht und setzt Richtlinien durch

- FinOps-Teams: arbeiten an der Schnittstelle zwischen IT, Controlling, Produktmanagement und DevOps, um Cloud-Ausgaben sichtbar und steuerbar zu machen

- Datenbesitzer: verantwortlich für die Daten in ihrem Bereich – von der Klassifizierung bis zu Löschfristen

So wird Governance keine reine IT-Aufgabe, sondern ein integrierter Bestandteil der Unternehmenssteuerung.

Einsatz moderner Tools zur Regelüberwachung und Automatisierung

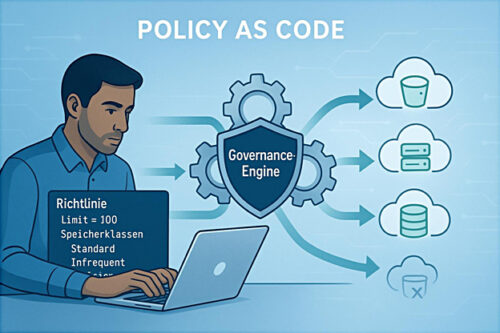

Ohne geeignete Tools bleibt jede Strategie Theorie. In der Cloud ist Automatisierung besonders wichtig. Ein moderner Ansatz ist Policy as Code: Regeln werden maschinenlesbar umgesetzt und kontinuierlich geprüft, z. B. mit Open Policy Agent (OPA), Terraform Sentinel oder AWS Config Rules. So lassen sich Regeln automatisch durchsetzen, und Abweichungen werden frühzeitig sichtbar.

Ebenso wichtig ist Infrastructure as Code (IaC), etwa mit Terraform oder Ansible. IaC sorgt für einheitliche Bereitstellung und Verwaltung und verhindert manuelle Fehlkonfigurationen, die im Nachhinein teuer werden können. Monitoring-Lösungen mit KI-Funktionen (z. B. AWS CloudWatch mit ML-Erkennung oder Azure Monitor mit KI-Analysen) erkennen Anomalien frühzeitig. Auch Sicherheitsdienste der Cloud-Anbieter sowie virtuelle Datenräume für sicheren Datenaustausch leisten einen wichtigen Beitrag zum Datenmanagement.

Regelmäßige Überprüfung und Anpassung der Richtlinien

Datengovernance ist ein kontinuierlicher Prozess. Cloud-Dienste, KI-Funktionen und gesetzliche Vorgaben entwickeln sich schnell weiter (z. B. NIS2, DORA, EU AI Act). Darum müssen Richtlinien regelmäßig geprüft und angepasst werden. Was früher ein jährlicher Review-Zyklus leistete, ist heute oft zu wenig. Eine vierteljährliche Überprüfung ist in den meisten Unternehmensumgebungen sinnvoll.

Diese Prüfungen halten Regeln und Abläufe aktuell, helfen, aus Vorfällen zu lernen, und bringen neue Best Practices ein. So bleibt Governance flexibel und unterstützt Geschäftsziele, anstatt zu starren Vorgaben zu erstarren.

Typische Fehler bei Cloud-Datengovernance und wie man sie vermeidet

Auch mit den besten Absichten passieren bei Cloud-Datengovernance häufig wiederkehrende Fehler. Sie führen zu mehr Aufwand, geringeren Einsparungen und neuen Risiken. Wer sie kennt, kann sie gezielt vermeiden.

Mangelhafte Datenklassifizierung

Einer der häufigsten Fehler ist fehlende oder unzureichende Datenklassifizierung. Wenn niemand weiß, welche Daten sensibel, geschäftskritisch oder selten genutzt sind, können keine passenden Regeln angewendet werden. Das führt entweder dazu, dass alle Daten kostenpflichtig in teuren Klassen gespeichert werden, oder dass sensible Daten unzureichend geschützt sind.

So vermeiden Sie diesen Fehler:

- Klare Datenkategorien festlegen (z. B. öffentlich, intern, vertraulich, streng vertraulich)

- Pro Kategorie Regeln definieren (Aufbewahrung, Zugriff, Compliance, Nutzung)

- Mitarbeitende gezielt schulen

- Tools einsetzen, die Daten automatisch scannen und nach Mustern klassifizieren

Nicht entfernte Alt- oder Testdaten

Viele Cloud-Kosten entstehen durch Daten, die längst gelöscht werden könnten: alte Backups, Snapshots, veraltete Datensätze oder vergessene Testumgebungen. Diese „Datenreste“ verursachen laufend Kosten und erhöhen die Unübersichtlichkeit der Umgebung.

Gegenmaßnahmen:

- Klare Lösch- und Archivierungsregeln etablieren

- Automatisierung einsetzen, die Testdaten und temporäre Ressourcen nach einer definierten Frist entfernt

- Lifecycle-Regeln für Archivdaten einrichten (zunächst günstigere Klassen, dann endgültiges Löschen nach Ablauf der Aufbewahrungsfrist)

- Regelmäßige Inventurprüfungen der Cloud-Umgebung durchführen, um vergessene Ressourcen zu identifizieren

Fehlende Automatisierung und Überwachung

Manuelle Governance funktioniert in der Cloud in der Regel nicht. Zugriffe, Kosten, Speicherklassen und Compliance-Anforderungen manuell zu verwalten ist langsam, fehleranfällig und ist nicht skalierbar. Wenn die Umgebung wächst, versagt dieser Ansatz zwangsläufig.

Fehlende Automatisierung geht häufig mit mangelnder Überwachung einher. Ohne kontinuierliches Monitoring werden Kostenprobleme oft erst auf der Rechnung sichtbar – und Sicherheitslücken häufig erst nach einem Vorfall.

So vermeiden Sie diesen Fehler:

- Policy as Code und Infrastructure as Code konsequent einsetzen

- Monitoring-Tools nutzen (cloud-nativ oder von Drittanbietern) für Kosten, Nutzung, Sicherheit und Compliance

- Kostenwarnungen und Budgetgrenzen einrichten

- FinOps-Praktiken implementieren, damit Ausgaben kontinuierlich überprüft und optimiert werden

Welche Vorteile haben Unternehmen durch stringente Datengovernance für die Cloud-Kostenkontrolle?

Stringente Datengovernance ist mehr als ein technisches Thema. Sie schafft echte finanzielle und betriebliche Vorteile – von besserer Budgetplanung über reduzierte Risiken bis hin zu höherer Datenqualität.

Transparenz und bessere Budgetplanung

Ein unmittelbarer Gewinn ist Kostentransparenz: Welche Daten liegen wo, wer nutzt sie, und was kostet das? Diese Sicht ist die Grundlage für fundierte Analysen und realistische Budgets. FinOps wird mit einer stabilen Datengovernance erst vollständig praktikabel: FinOps-Teams können Ausgaben sichtbar machen, planbar halten und optimieren, indem sie IT, Controlling und Produktmanagement miteinander verbinden.

Mit dieser Transparenz lassen sich Engpässe und Verschwendung identifizieren, Budgets präziser planen und Ausgaben besser prognostizieren. Unternehmen treffen fundierte Entscheidungen zu Cloud-Diensten, Speicherklassen und Ressourcenzuteilung. Das reduziert finanzielle Überraschungen und lenkt Investitionen dorthin, wo sie tatsächlich Wirkung entfalten.

Nachhaltige Reduzierung laufender Betriebskosten

Ein zentrales Ziel ist die Reduzierung laufender Betriebskosten (OpEx). Datenklassifizierung, Deduplizierung, Komprimierung und automatisiertes Lifecycle-Management beseitigen unnötige Ressourcen und überführen Daten in passende, kostengünstigere Klassen. Das senkt die Speicherkosten direkt und messbar.

Gleichzeitig sinkt der manuelle Aufwand: Automatisierung entlastet IT-Teams von Routineaufgaben, Fehler treten seltener auf, und der Nachbearbeitungsbedarf sinkt. Wenn Schatten-IT vermieden und Cloud-Ressourcen bedarfsgerecht eingesetzt werden, gehen auch die Gesamtbetriebskosten zurück.

Sicherstellung von Compliance und Datenqualität

Compliance und Datenqualität wirken auf den ersten Blick nicht wie klassische Hebel zur Kostenreduktion – die finanziellen Konsequenzen von Verstößen und schlechter Datenqualität können jedoch erheblich sein. Stringente Datengovernance hilft, Regelwerke wie DSGVO, NIS2, DORA oder den EU AI Act einzuhalten. Damit sinkt das Risiko hoher Bußgelder, Imageschäden und Rechtsstreitigkeiten. Zudem ist es bei Audits entscheidend, nachweisen zu können, dass Cloud-Risiken systematisch gesteuert werden.

Zusätzlich steigt die Datenqualität: Governance-Regeln sorgen für konsistente, nachvollziehbare und korrekte Daten. Das ist für Berichte, Analysen und insbesondere für KI-Anwendungen unverzichtbar. Schlechte Daten machen Projekte kostspielig und führen zu Fehlentscheidungen. Branchenanalysten wie Gartner haben wiederholt darauf hingewiesen, dass ein Großteil der KI-Projekte an schwacher Datenbasis scheitert – eine fundierte Governance-Strategie ist daher eine direkte Investition in den Projekterfolg. Gute Datenqualität führt zu besseren Ergebnissen und verhindert teure Korrekturen. Compliance und Datenqualität sind damit auch ein starker, indirekter Hebel zur nachhaltigen Kostenkontrolle.

Ausblick: Warum strategische Datengovernance die Cloud-Speicherökonomie bestimmt

Cloud-Speicher wird zunehmend nicht mehr als reine Infrastruktur betrachtet. Immer deutlicher wird: Strategische Datengovernance entscheidet darüber, wie wirtschaftlich Cloud-Speicher im Unternehmen wirklich genutzt werden kann. Datenmengen wachsen weiter, nahezu alle Geschäftsprozesse werden digitaler, und regulatorische Anforderungen verschärfen sich. Passives Datenmanagement ist keine Option mehr.

In den kommenden Jahren wird die Fähigkeit, Cloud-Daten effizient, sicher und regelkonform zu verwalten, direkt über Reaktionsgeschwindigkeit, Wettbewerbsfähigkeit und wirtschaftlichen Erfolg entscheiden. Strategische Datengovernance hilft, die Vorteile der Cloud – Flexibilität, Skalierung, Innovationskraft – zu nutzen, ohne die Kontrolle über Kosten und Risiken zu verlieren. Sie schafft die Grundlage für vertrauenswürdige Daten, die auch für KI-Anwendungen optimal nutzbar sind, und bildet damit das Fundament für automatisierte Prozesse und schnelle, datenbasierte Entscheidungen.

Neue Vorgaben wie NIS2, DORA oder der EU AI Act erhöhen den Druck, Cloud-Prozesse kontrolliert und nachvollziehbar zu gestalten. Diese Regelwerke sind nicht nur „Mehrarbeit“ – sie stoßen häufig notwendige Verbesserungen an, weil Unternehmen aktiv werden und ihre Datenstrategie überarbeiten müssen. Auch Nachhaltigkeit (GreenOps) und Energieeffizienz gewinnen an Gewicht, da sie finanzielle Auswirkungen haben und Bestandteil von ESG-Berichten werden.

Datengovernance muss daher fest in die IT- und Unternehmensstrategie integriert sein. Sie sollte bereits in der Planungsphase von Cloud-Projekten beginnen und als kontinuierlicher Prozess verstanden werden – mit regelmäßiger Überprüfung und Anpassung. Unternehmen, die das konsequent umsetzen, profitieren von klarer Datentransparenz, automatisierten Qualitäts- und Zugriffsregeln, integrierter Sicherheit und Compliance sowie nachvollziehbaren Audit-Nachweisen.

Wer Cloud-Datengovernance hingegen als Nebenthema behandelt, riskiert überhöhte Kosten, Regelverstöße und verliert die Chance, aus den eigenen Daten echten Mehrwert zu ziehen. Strategische Datengovernance wird damit zum zentralen Steuerungsinstrument für Cloud-Speicher und nachhaltiges Kostenmanagement.

Kurz-URL: https://leimenblog.de/?p=202540